Täna räägime deepfake’ist, mis on nüüdseks muutunud laialt levinud ja juba üsna tavaliseks nähtuseks. Tänu sellele tehnoloogiale on infoga manipuleerimine jõudnud uuele tasemele.

Kas nägite uusaastasõnumi saates kuninganna Elizabethi laual tantsimas? Või kuulas Kim Jong-uni kõnet demokraatiast või imetles Salvador Dalit, kes rääkis oma surmast (miks ta sellesse ei usu)?

Kõigil neil hämmastavatel videotel on üks ühine joon – need on võltsitud. Deepfake on valeteabe loomise ja avaldamise tehnika videote, heli ja fotode kujul. Selliste materjalide leidmine on muutumas üha lihtsamaks, seetõttu oleme teile koostanud juhendi sügavvõltsitud videote loomise, tuvastamise ja otsimise kohta Internetis.

Loe ka: Homsed plokiahelad: krüptovaluutatööstuse tulevik lihtsate sõnadega

Deepfake - mis see on?

Deepfake (Deepfake) on tegelikult foto-, video- või helimaterjal, mis pole päris, võlts ehk võlts. Deepfake (kombinatsioon kahest sõnast – deep learning "deep learning" ja fake "fake") kasutab süvaõppeks tehisintellekti (AI), et luua videotes ja muudes digitaalse meedia materjalides ühe inimese sarnasust teisega. See luuakse algoritmide abil, mis põhinevad päris hääle-, heli-, video- või fotonäidistel, mis on kokku õmmeldud. Algoritm võtab valitud teabe paljudest erinevatest kohtadest ja ühendab selle seejärel üheks materjaliks. Selle tulemusena tekib midagi uut (vale), mis põhineb erinevate reaalsete andmete kombinatsioonil.

Kuid see pole veel kõik. Deepfake võib ka nullist foto "maalida", luues näiteks tegelaste näod, keda pole kunagi olnud.

Mis on selliste toimingute eesmärk? Muuhulgas kasutatakse Deepfake'i Internetis ebaõige teabe levitamiseks (näiteks poliitiliste tegelaste või sündmuste kohta), vargusteks (näiteks häälkäskluste võltsimiseks) ja pornograafia loomiseks (filmid kuulsustega - deepfake porn). Seda saab kasutada ka haridus- ja meelelahutuslikel eesmärkidel.

Loe ka: Kvantarvutitest lihtsate sõnadega

Deepfake – kuidas see töötab?

Üldiselt on sügavvõltsmaterjali loomiseks kaks võimalust. Esimene meetod kasutab kahte algoritmi. Esiteks otsib esimene (kodeerija) kahe pildi (üheks ühendamise) ühiseid jooni, seejärel saab teine (dekooder) need vastloodud pildile üle kanda. Näiteks kui tahame luua video, milles näitleja liiguks nagu meie, võtab kodeerija liikumise videost, kus me tantsime, ja dekooder asendab juba meie näo näitleja näoga ja paneb ta meie liigutusi reprodutseerima. . Siin on võtmeks valitud toimingud, mis kopeeritakse uuele pildile (näiteks liigutused, žestid, näoilmed).

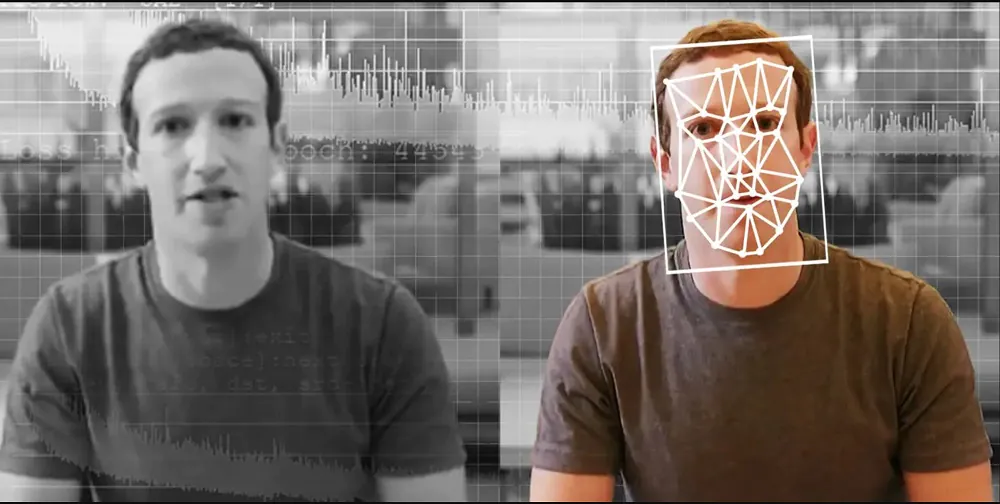

Teine võimalus on generatiivsete võistlevate võrkude (GAN) kaudu, kus kaks algoritmi töötavad koos. Esimest nimetatakse generaatoriks, kuna see loob üldinfot kasutades kujutisi (näiteks inimese kujutist), mis ühendavad selle eristavad tunnused (inimesel on keha, nägu, silmad). Teine algoritm on diskriminaator, mis hindab, kas generaatori poolt talle antud kujutised vastavad tõele või mitte.

Aja jooksul muutuvad mõlemad algoritmid arenenumaks, nii et nad õpivad ja täiustavad ennast. Kui generaator on koolitatud nii, et diskrimineerija võltsfotot ära ei tunne (peab seda tõeliseks), on protsess lõppenud.

GitHubist, skriptide, programmide ja koodi avatud lähtekoodiga kogukonnast, leiate suure hulga võltsitud tarkvara. Mõnda neist programmidest kasutatakse puhtalt meelelahutuslikel eesmärkidel, seega pole sügavvõltsingu loomine keelatud, kuid paljusid neist saab kasutada ka kriminaalsetel eesmärkidel.

Paljud eksperdid usuvad, et tulevikus muutuvad süvavõltsingud tehnoloogiate arenedes palju keerukamaks ja võivad tekitada ühiskonnale tõsisemaid ohte, mis on seotud valimistesse sekkumise, poliitiliste pingete tekitamise ja kuritegeliku tegevusega.

Loe ka:

- Punase planeedi vaatlemine: Marsi illusioonide ajalugu

- Teleportatsioon teaduslikust vaatenurgast ja selle tulevik

Deepfake'i oht – mis ajast see eksisteerib?

Esimest korda ilmus selline võltsinfo 2017. aastal. Siis on kasutajaks alias sügav fake avaldas Redditis mitu pornograafilist filmi, milles osalesid kuulsused, sealhulgas Scarlett Johansson, Gal Gadot ja Taylor Swift. Sellest ajast alates on see tööstus kiiresti arenenud, sest peaaegu igaüks saab teha sügavvõltsitud filme.

https://youtu.be/IvY-Abd2FfM

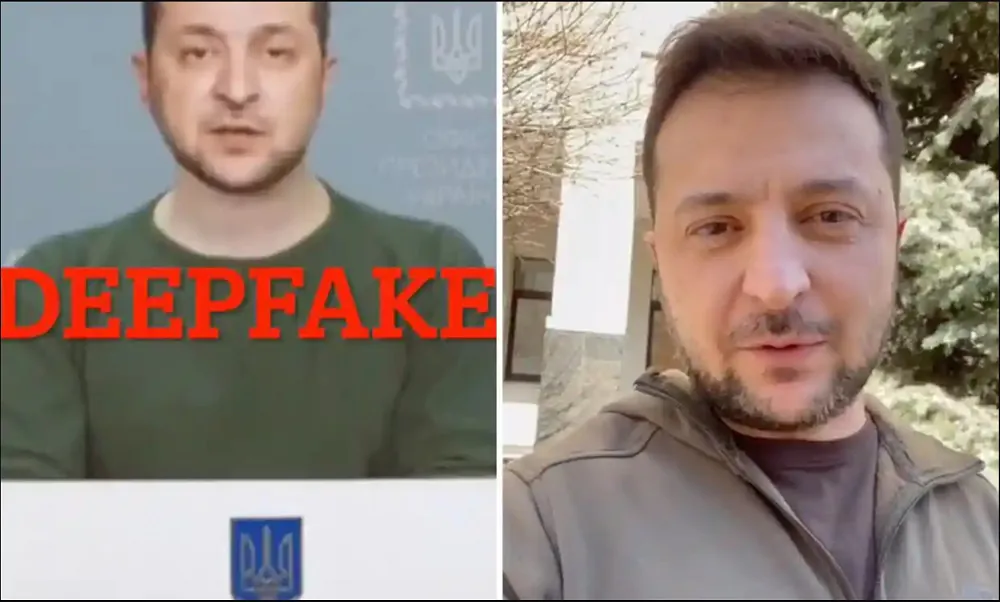

Viimastel aastatel on süvavõltsimise tehnoloogia nii palju arenenud, et nüüd on üha raskem kindlaks teha, kas tegemist on fabritseeritud video või ehtsate inimeste jäädvustusega. Näitena võib tuua video Elizabeth II sõnumiga või Barack Obama kõne, mis avaldati kiiresti paljudel erinevatel saitidel. USA endise presidendi avaldusega video käsitles globaalseid ohte, mida võivad põhjustada Internetis avaldatud desinformatsioon ja võltsuudised. Kanali BuzzFeedVideos avaldatud materjalis sai USA režissöör ja näitleja Jordan Peele Ameerika Ühendriikide 44. presidendi häälekandjaks. Kuid praegu on tehisintellekt juba võimeline genereerima häält inimese arhiivisalvestuste põhjal, kes peaks esinema võltsfilmis.

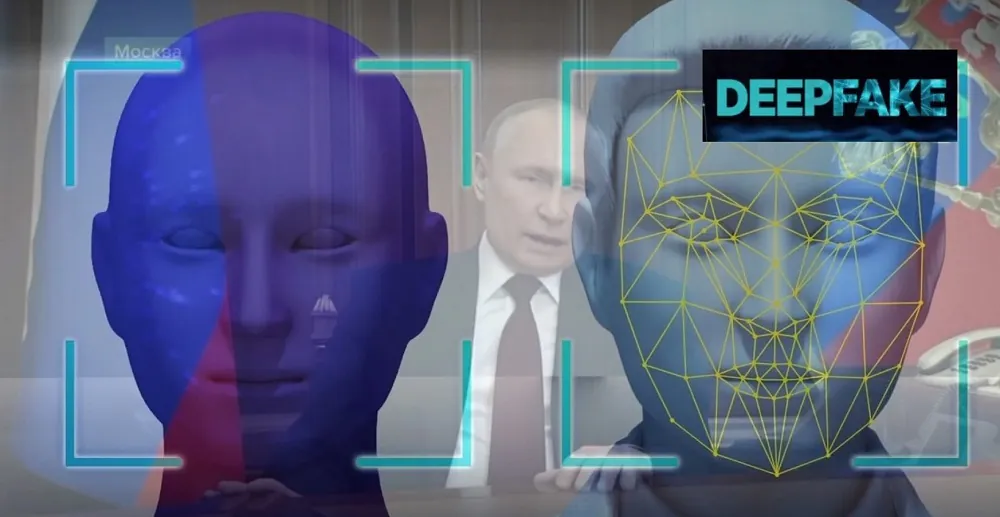

Sellised arenenud tehnoloogiad võivad tulevikus muutuda küberkurjategijate ja internetipetturite käes ohtlikuks tööriistaks. Oluliste poliitikute kõnedest võltsvideote avaldamine võib rahvusvahelisel tasandil tekitada tõelist kahju. Sellised sügavvõltsitud tehnoloogial põhinevad filmid võivad põhjustada diplomaatilisi konflikte ja skandaale ning seeläbi mõjutada avalikku arvamust ja inimeste käitumist.

Teine potentsiaalne oht on täiskasvanutele mõeldud sisu, mis on virtuaalses ruumis alati kõige rohkem liiklust tekitanud. Pole ime, et sügavvõltsitud tehnoloogia Internetti nii kiiresti jõudis. Hollandi küberjulgeolekufirma Deeptrace raporti kohaselt on 96% süvavõltstehnoloogia abil loodud fabritseeritud videotest sellistel teemadel sisu. Kõige sagedamini kasutatakse selliste materjalide valmistamiseks filmistaaride, sportlaste ja isegi poliitikute ja valitsuse esindajate pilte.

Loe ka: Miks kosmosemissioon igal hetkel lennata ei saa: Mis on stardiaken?

Kuidas sügavvõltsingut teha?

Kui keegi oskab deepfake videosid teha, siis kas neid saab ka kodus teha? Kindlasti jah, kuid nende kvaliteet ei saa loomulikult olema täiuslik. Selliste videote loomine nõuab suuri arvutusressursse ja võimsaid videokaarte. Nendest, mis meil tavaliselt koduarvutites on, ei piisa ja arendusprotsess ise võib kesta nädalaid. Soovida jätab ka filmide kvaliteet - esineb nähtavaid vigu, suuliigutused ei pruugi helile vastata, on nähtavaid kohti, kus "vana" sisu kattub "uuega".

Kui aga tahame mõnda fotot veidi "liigutada" või teha lühikest deepfake videot, saab selleks mõeldud programmi otse nutitelefoni alla laadida. Väga lihtsalt kasutatav programm kõrvaldab mõne minutiga välimuse vead, muudab sinust valitud kuulsuse või laseb sinu koeral rääkida inimhäälega.

Loe ka:

- Punase planeedi vaatlemine: Marsi illusioonide ajalugu

- Teleportatsioon teaduslikust vaatenurgast ja selle tulevik

Kuidas sügavvõltsingut ära tunda?

Professionaalseid sügavvõltsitud videoid on üha raskem märgata. Alguses oli algoritmidel probleeme elementaarse käitumisega (näiteks silmade pilgutamine) ja kohe oli selge, et film on võlts. See viga on nüüd parandatud. Võltstegelased vilguvad, liiguvad loomulikult ja räägivad ladusalt. Kuid mõnikord on neil endiselt probleeme silmade loomuliku liikumisega.

Niisiis, kuidas tuvastada sügavvõltsingut? Siin on, millele peaksite videot vaadates tähelepanu pöörama:

- Kas heli järgib suu liigutusi? Mõnikord ei sobi need täpselt kokku ja videos olev inimene liigutab oma huuli heli suhtes viivitusega või liigendab sõnu valesti.

- Igasugused nähtused, mis tunduvad ebaloomulikud. Jutt käib siin muuhulgas kogu keha või pea asendist torso suhtes, valguse valest peegeldusest esemetel, valguse valest peegeldusest ehetes jne. Ebaloomulik nahavärv võib samuti olla märk sellest, et kile on võlts.

- Heli ja video kvaliteet. Nende erinevus aitab tuvastada sügavat võltsimist. Tavaliselt on heliriba kehvema kvaliteediga.

- Kujutise ebakorrapärasused. Enamasti ilmuvad need keha ja pea ristmikul. Kui kuulsuse pea on "liimitud" teise keha külge, võib kaela piirkonda tekkida udu. Mõnikord esineb kaadri vahelejätmist (katkendus) ja kaadri vigu (erinev valgusnurk, tüüp või suund).

- Räsimärgi muutmine video ajal võib tähendada ka seda, et meil on sügavvõltsitud video.

Deepfake’i vaatenurgast materjale vaadates tasub toetuda ka enda tunnetele. Mõnikord jääb meile mulje, et midagi on "valesti". See juhtub muuhulgas siis, kui ekraanil kujutatud inimese emotsioonid ei ühti sellega, mida näoilme või hääletoon meile näitab. See viitab ka sellele, et video võis olla võltsitud.

Huvitav ka:

- 10 veidramat asja, mida me 2021. aastal mustade aukude kohta õppisime

- Marsi terraformeerimine: kas punane planeet võib muutuda uueks Maaks?

Kuidas end sügavvõltsimise eest kaitsta?

Sügava võltspettuse vältimiseks soovitavad eksperdid järgida järgmisi samme:

- Loo koos lähedastega, näiteks pereliikmete või kolleegidega salasõna või loosung, kes video või salvestise abil olukorra reaalsust tõestavad. See võimaldab teil kiiresti kontrollida olukorra valet ja vältida näiteks raha väljapressimist.

- Leppige sugulaste või kolleegidega kokku teabeloend, mida ei küsita kunagi sõnumite kaudu, näiteks sotsiaalvõrgustikes või SMS-is. Kõigile huvitatud isikutele tuleb kindlasti teatada ohu tegelikust ulatusest.

- Mitmefaktoriliste autentimiskanalite juurutamine iga päringu kontrollimiseks. Kui suhtlus algab tekstisõnumiga, siis kõige kindlam viis info kinnitamiseks on võtta sõnumi saatjaga ühendust vestluse vormis eelnevalt kokkulepitud ja turvalise suhtluskanali kaudu.

- Turvaalase kompetentsi pidev täiendamine, näiteks töötajate turvalisuse ja küberkuritegevuse alase koolituse näol. Teadlikkuse tõstmine selle kohta, mis on deepfake ja kuidas sellele ohule vastu seista.

- Turvasüsteemide tugi ja arendamine info- ja kommunikatsioonitehnoloogia (IKT) keskkondades.

Kus võib sügavvõltsingut kohata?

Võltsmaterjali võib leida kõikjal, kus see võib jõuda suure vaatajaskonnani, st potentsiaalse deepfake publikuni. Facebook, Instagram, TikTok ja muud sotsiaalmeedia saidid on sedalaadi asju täis.

Need pole mitte ainult hämmastavad videod, vaid ka "rafineeritud" fotod ja helisalvestised. Mõned autentsed kuulsuste profiilid on mõnikord täielikult võltsitud asjadega täidetud!

See pole ainus koht, kust leiate sügavvõltsi. Sellel tehnoloogial põhineb ka rakendus nutitelefonile, mis võimaldab fotole lisada vuntsid ja habe või muid eriefekte (näiteks mitmekümne aasta võrra vananemine). Seega võib selguda, et viimane foto, mille sõpradelt saadi, on veidi "alajoonistatud".

Huvitav ka:

Deepfake filmid pole ainult pornograafilised

Deepfake'i kasutamine võib olla nii positiivne kui ka negatiivne. Deepfake filmid võivad olla mängulised või meelelahutuslikud. Siinkohal tuleks mainida videot kuninganna Elizabethist, kes uue aasta sõnumi ajal laual tantsis. See on ka enamiku fotode modifikatsioonide eesmärk, mida me oma nutitelefonides sügava võltsingu rakendusega teeme. See peaks olema naljakas ja lõbus.

Deepfake materjalid võivad mängida ka harivat rolli, näiteks "ellu äratada" juba surnud artiste, lauljaid või muusikuid. Mõned muuseumid, eriti Florida Salvador Dali muuseum, kasutavad seda tehnoloogiat, kus külastajatele "esitleb" oma teoseid kunstnik ise, kellega saab rääkida ja isegi pilte teha.

Deepfake tehnoloogiat kasutatakse häälegeneraatorites – seadmetes, mis on mõeldud kõnevõime kaotanud inimestele. Tänu neile saavad sellised inimesed meiega ikka oma häälega rääkida. Val Kilmeri hääl, mille ta kaotas kõrivähi tõttu, oli modelleeritud filmis Top Gun: Maverick.

Kahjuks on meil ka palju näiteid sügava võltsimise negatiivsete kasutusviiside kohta. Poliitika on näide, kus sellisel valeinfol võivad olla kaugeleulatuvad globaalsed tagajärjed, näiteks avaliku elu tegelaste diskrediteerimine, aktsiaturu, majanduse või valimistulemuste mõjutamine või isegi sõjapidamise korraldamine sõjas. Hästi ettevalmistatud protokoll muudab avaliku arvamusega manipuleerimise lihtsamaks. Tehnoloogiate järkjärguline areng muudab tõeliste materjalide võltsingutest eristamise veelgi keerulisemaks. Niisiis, see on samm sotsiaalse usalduse ja teabekaose languse suunas.

Deepfake videod, nagu me juba mainisime, on pornotööstuses laialt levinud. Enamasti seisnevad muudatused pornonäitleja/näitleja näo asendamises kuulsuste või filmistaaride näoga, loomulikult ilma nende nõusolekuta.

Loe ka: Mehitatud kosmosemissioonid: miks on Maale naasmine endiselt probleem?

Deepfake on tõeline oht meile kõigile

Deepfake pole ainult näitlejate ja poliitikute probleem. Võltsitud sisu võib mõjutada kõiki. Väljapressimise ja väljapressimise elemendiks võib olla väljamõeldud video, milles paneme toime kuriteo või satume ebaselgesse olukorda – kas maksate teie või meie paljastame. Kui töötate äris, peate mõistma, et on oht kasutada sügavat võltsimist ettevõtte diskrediteerimiseks selle vastaspoolte seas.

Manipuleeriva materjali hulga suurenemine võib mõjutada ka sotsiaalset usaldust ja usaldust pakutava teabe vastu. Kuidas saab midagi uskuda, kui kohtus tõendiks olev film võib olla vale ja uudised kajastavad olematuid sündmusi?

Tehnoloogia, mis võimaldab luua pahatahtlikku pilti, helisalvestist või filmi, mille tegelased sarnanevad väga teiste inimestega, on küberkurjategijate ohu uus tase. Eriti arvestades asjaolu, et sotsiaalvõrgustikes saavad nad süvavõltsingute loomiseks hankida peaaegu piiramatud lähtematerjali ressursse.

Masinõppetarkvara saab otsida Facebook abo Instagramnäiteks ja püüda potentsiaalsetest "näitlejatest" huvitavaid fotosid või videoid. Selle põhjal saab luua inimesest väga selge hääle, pildi ja video, kuid spetsiaalselt loodud võltsapelliga, mis simuleerib näiteks tõsises hädas olemist - inimröövi või õnnetuse ohvrina. Järgmises etapis genereeritakse võltsitud abipalve, näiteks rahaline, adresseeritud "ohvri" lähedastele.

Loe ka: James Webbi kosmoseteleskoop: 10 sihtmärki, mida jälgida

Võitlus deepfake’i vastu

Valeinfo voog on nii suur, et paljud suhtlusvõrgustikud on otsustanud võidelda sügavvõltsingute vastu. Facebook і Twitter proovige tuvastada võltsvideod ja need automaatselt kustutada. Suured ettevõtted (sh Microsoft või Amazon) investeerivad tarkvara, mis tuvastab võltsitud sisu. Teadlased töötavad ka sellele probleemile lahenduse kallal.

Samas olukorras, kus võltsfilmi loomiseks piisab nutitelefoni rakendusest, on deepfake’iga võitlemine nagu tuuleveskite vastu võitlemine. Samuti puuduvad õigusnormid, mis määraksid sellise teabega manipuleerimise või kellegi teise kuvandi kasutamise tagajärjed.

Deepfake on muutumas üha populaarsemaks ja seda on üha raskem tõest eristada. Selle põhjuseks on tehnoloogiate täiustamine, mis suudavad paremini jäljendada inimese liigutusi ja žeste. Deepfake’e saab kasutada headel eesmärkidel, näiteks õppematerjalide loomiseks või kõrioperatsiooni järel hääle kaotanud inimeste abistamiseks, kuid need on abivahendiks ka häkkeritele, väljapressijatele ja internetitrollidele.

Seega, kui leiate Internetis taas hämmastava video, kontrollige esmalt, kas seda pole mõnikord muudetud või võlts. Võib-olla pole see, mida te vaatate, kunagi tegelikkuses!

Loe ka:

- 100 aastat kvantfüüsikat: 1920. aastate teooriatest arvutiteni

- 5 tulevast kosmosemissiooni, millele mõelda

Kuid ärge unustage, et Ukrainas on käimas sõda. Kui soovite aidata Ukrainal võidelda Vene okupantidega, on parim viis seda teha annetada Ukraina relvajõududele Päästa elu või ametliku lehe kaudu NBU.